In un momento tempestato da disperate richieste di pace, il discorso della modernità si insinua nel mostro della guerra, in una questione etica che mette a dura prova lo statuto morale delle cosiddette “armi intelligenti”.

Il Messaggero riporta di alcune presunte richieste d’aiuto russe alla Cina. Di risposta, gli annunci vengono smentiti per un invito alla pace e alla tranquillità internazionale: nell’intervista di Ebe Pierini a Lorenzo Termine (link all’articolo), ricercatore ed esperto in geopolitica, si legge la possibilità di un aiuto “para-militare” dalla controparte cinese, l’intelligenza artificiale.

LA SITUAZIONE ATTUALE

La situazione attuale ha mosso la comunità internazionale in blocco, spostando l’occhio di bue sulla questione della guerra in un tempo di modernità come quello vissuto. Testate giornalistiche si sono riempite di storie di sangue e di violenza, in un richiamo collettivo alla pace e alla condanna dei crimini di guerra “nel 2022”. Molti si sono interrogati su come la guerra potesse essere “ancora” un’opzione e la domanda è rimasta la stessa: “come è possibile che, “nel 2022″, potremmo rischiare un terzo conflitto mondiale?”

Come scrive l’Huffington Post in un articolo datato 17 Ottobre 2021 (link all’articolo), le armi a funzionamento autonomo rappresentano la terza rivoluzione della guerra, dopo la polvere da sparo e la, molto temuta, forza del nucleare. In un panorama di sviluppo militare autonomo che vede Usa, Russia e Cina in prima fila come finanziatori, la deriva nucleare potrebbe spaventare di meno rispetto al problema di droni, soldati e macchine autonome dotate di intelligenza artificiale.

INDUSTRIA BELLICA E IMPORTANZA ECONOMICA

L’industria bellica è una delle più proficue al mondo, vantando numeri a ben più di 9 cifre. Il report annuale di Sipri ci regala un quadro attuale delle spese militari internazionali, chiarendo l’impatto di quest’ultime sull’economia globale. Di seguito si legge:

“Si stima che nel 2020 la spesa militare mondiale abbia raggiunto i 1.981 miliardi di dollari. La spesa totale è stata più alta del 2,6% rispetto al 2019 e del 9,3% rispetto al 2011.L’onere militare globale – la spesa militare

globale come quota del prodotto interno lordo globale – è cresciuta di 0,2 punti percentuali nel 2020, raggiungendo il 2,4%. Questo è stato l’aumento più consistente dalla crisi finanziaria ed economica del 2009.” (Fonte: SIPRI 2021; link)

Non a caso uno degli unici settori che in Italia, durante il periodo di quarantena della primavera del 2020, era ancora in funzione era proprio quello dell’industria delle armi (link all’articolo de Il Manifesto). È impossibile immaginare uno Stato senza risorse militari, ma è anche impossibile negare quanto valore economico abbia lo sviluppo e la ricerca in questo ambito: poter aggiornare l’armamento di un determinato Stato declina una spesa necessaria per ogni nazione.

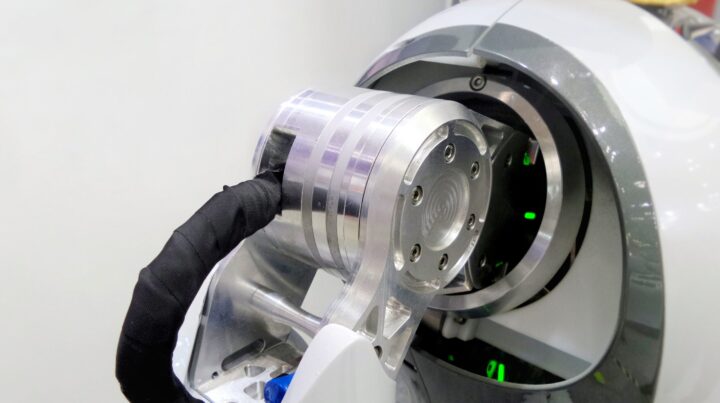

Alcuni esempi di ricerca in ambito di armi autonome sono quelle condotte dalla Darpa, l’Agenzia statunitense per la Difesa: già nel 2015, negli Stati Uniti, venivano svolti numerosi esperimenti per completare il perfezionamento di proiettili in grado di colpire bersagli in movimento e correggere la loro traiettoria con precisione ineffabile. Continuando, i ben più famosi “droni killer”: la lista è piuttosto lunga.

LA QUESTIONE ETICA SULLE ARMI AUTONOME

La filosofia e l’etica rivestono un ruolo di fondamentale importanza in merito alle questioni di natura morale e giuridica. Nel caso delle armi intelligenti autonome, la questione ricade sull’agente colpevole. In altre parole, se una macchina dovesse uccidere un innocente, su chi ricadrebbe la colpa? Sul programmatore, sullo Stato che ne fa utilizzo? Più a fondo, la questione si sposta anche sulla stessa legittimità delle armi autonome. Ancora una volta, tecnologia e potere politico-militare si confondono, in una potenzialmente pericolosa “accoppiata”.

In una famosa “lettera aperta”, illustri nomi del mondo dello sviluppo tecnologico – tra cui Stuart Russell e Peter Norvig, famosi ricercatori nell’ambito dell’intelligenza artificiale, oltre a Stephen Hawking, Frank Wilczek e Elon Musk – hanno espresso paura nei confronti di una ricerca senza limiti giuridici in ambito di armi autonome. La questione rimane aperta, ma pare necessario riportare un passaggio di questo scritto:

“The key question for humanity today is whether to start a global AI arms race or to prevent it from starting.”